最近两年,AI行业最热的词一直是“算力”。从大模型训练到Agent爆发,再到各家云厂商疯狂扩建智算中心,好像只要GPU够多,AI就能继续飞。但现实是——机器越来越贵,GPU越来越强,训练和推理的效率却没有同步提升。问题可能不在算力本身,而在另一件长期被忽视的事情上:网力。

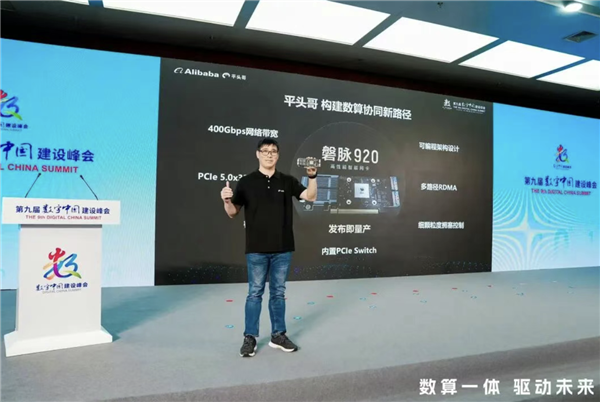

平头哥产品总监李旭慧打了个比方:“算力是AI时代的石油,网力就是输油管道。算力提供动力,网力保障效率。”4月28日,在数字中国建设峰会上,平头哥发布首款智能网卡磐脉920。这是国内首个内置PCIe Switch的400G智能网卡,最大支持400Gbps吞吐带宽,专为万卡智算集群、通算集群和高性能存储设计,目前已经量产,将率先部署在阿里云数据中心。

磐脉920要解决的就是“网力”问题。今天的大模型训练动辄需要几千甚至上万张GPU协同,单张GPU再强也得跟整个集群保持同步。只要一部分节点慢下来,其他节点就得空等。李旭慧透露,目前很多万卡级智算集群的GPU实际利用率很低,“做到60%已经算行业顶尖水平”。问题不在于有多少卡,而在于系统效率被最慢的那个节点拖累,领先节点的算力持续闲置。

所以,当GPU已经足够强之后,下一步该补哪里?答案就在这张网卡上。

一张网卡,盘活整个智算集群

Agent应用爆发后,推理业务的增长显著快于训练。大模型训练强调强同步,推理却要面对大量突发、小包、高频请求,对低时延和稳定性的要求更高,这也意味着对网力的要求更高。磐脉920做的事,就是尽量减少整系统里的“堵”和“等”,通过网力释放算力。

它的核心设计有三个关键。

首先是多路径RDMA。通俗说,原本只能走一条高速,现在多条路同时分流,数据分开走还能按顺序准确拼回来。磐脉920支持逐包喷洒、乱序接收和选择性重传,实测单QP就能打满400G带宽,而同类主流产品带宽大约只有一半。多路径能力还能把交换机端口缓冲区水线降低90%,减少丢包和重传。

第二个关键是把“绕路”变成“直连”。磐脉920是国内首款内置PCIe Switch的400G智能网卡。传统服务器里PCIe Switch在主板上,数据得绕多个节点转发,路径长短不一,时延不齐。它对训练这种需要高度同步的任务很致命。磐脉920把PCIe Switch直接集成进芯片,让网卡与CPU、GPU更直接连接。根据平头哥实测,在相同集群规模下,部署磐脉920后训练和推理任务完成时间可缩短14%。

第三个关键是让网络具备自判断能力。传统网卡像搬运工,收到数据搬过去就行。磐脉920加入了细粒度网络感知和可编程拥塞控制,能主动避堵。网络从被动传输变成主动调度,这对越来越复杂的AI集群尤为重要。

这些设计并不追求参数上的简单提升,而是让已经很贵的算力少浪费一点,激发最大潜能。

为何是阿里在定义AI基础设施?

除了性能本身,磐脉920背后更值得关注的是平头哥和阿里整体的布局。过去很多公司做芯片集中在单一环节,但平头哥的思路是做全栈。目前它已形成四条产品线:真武AI芯片、倚天服务器CPU、镇岳存储主控芯片,以及磐脉智能网卡,正好对应数据中心里的算力、存力、网力。李旭慧说:“单一芯片产品无法解决全链路问题,只有打通算力、存力、网力,才能最大化释放AI硬件性能。”

这和很多单点芯片公司不同。平头哥不是先做产品再找客户,而是从阿里云自身业务中判断需求。磐脉920立项时AI智能体还没成为焦点,但他们从阿里云一线场景预判了网络升级的必要性。先有大规模业务场景,再从场景倒推产品定义——这是一种“通云哥”协同的闭环:通义负责模型,阿里云负责场景,平头哥负责底层硬件。模型需求推动云基础设施升级,云场景又反向推动芯片演进。这种全栈自研的模式投入大、周期长,但一旦走通,护城河极深。

AI竞争走到今天,比拼的不再是单点能力,而是整个系统能否顺畅运转。随着AI从训练走向推理,模型、云与芯片之间的持续反馈循环,整体优势的显现可能才刚刚开始。