AiSiri网3月17日讯,近日,苹果AI研究团队悄然扔出了一枚重磅“学术炸弹”——一个名为LiTo(表面光场标记化)的大模型。其剑指计算机图形学与AI长期以来的攻坚目标:高质量3D重建。

过去,想让AI从无到有生成一个立体的3D物体,需要喂给它多角度、多光照条件的海量图片,过程复杂,计算成本高昂。而LiTo模型的核心突破在于,它能仅凭一张普通的二维照片,就“脑补”出该物体的完整三维形态和在不同角度、光线下的逼真外观,包括微妙的镜面高光和菲涅尔反射效果。

这项技术并非简单的“贴图膨胀”。据研究论文披露,其关键在于一种创新的“统一的3D潜在表示法”。简单来说,模型通过编码器将单张图像的几何结构和外观特征,压缩成一个极其紧凑的数学向量(即“潜在代码”)。而解码器则像一个精通光线与材质物理规律的全能工匠,能根据这个代码,逆向、精准地重建出物体在各个视角下的模样。

为了训练出这种“一叶知秋”的能力,研究团队投入了巨大资源。他们在包含数千个3D对象的数据集上,让模型学习了多达150个不同视角和3种光照条件的变化规律。最终,模型得以从单一画面中“推理”出整个三维世界的潜在结构。

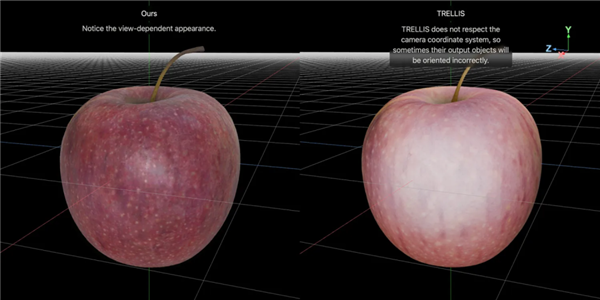

在关键的量化测试中,LiTo展示了其技术优势。它不仅严格遵守了摄像机坐标系,解决了同类AI常犯的“物体朝向混乱”问题,其“多视角光影一致性”指标,更是比当前业界最优的模型(TRELLIS)提升了约37%。这个数字在追求极致逼真度的图形学领域,意味着显著的代际差距。

商业深度观察:苹果此举远不止一次炫技式的研究发布。在AI竞争全面进入“空间计算”时代的背景下,高效、低成本的3D内容生成能力,是构建元宇宙、增强现实(AR)生态的核心地基。想象一下,未来iPhone用户随手拍一张商品照片,就能瞬间生成可放入AR场景中交互的3D模型;或者为开发者提供工具,将海量2D网络图片库快速转化为3D资产。这背后是内容创作范式的颠覆,也是苹果为其Vision Pro等硬件长远布局、构建内容护城河的关键一步。当其他厂商还在卷文本生图和视频时,苹果已在默默绘制下一代三维交互世界的蓝图。