如果最近你怀疑一篇严谨工整、过渡词恰到好处的项目文书或商业提案是AI生成的,那么恭喜你,你可能猜反了。一位肯尼亚作家用自己的亲身经历,揭示了一个颇具讽刺性的事实:不是他模仿了AI的腔调,而是AI在无意中“继承”了他——以及无数和他经历相似者的——写作风格。

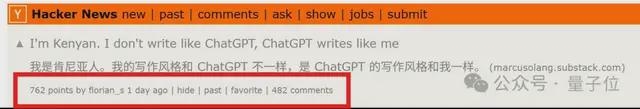

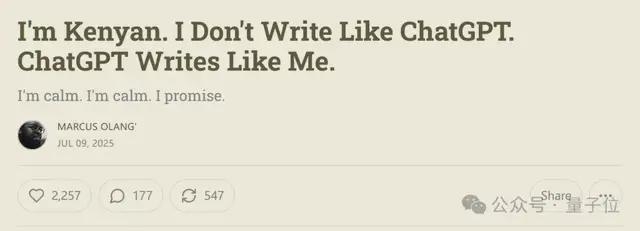

这位名叫Marcus Olang’的作家近来频频碰壁,其投递的多篇结构清晰、逻辑严谨的文章,屡屡被退稿,理由出奇的一致:“文风太像ChatGPT”。而当他认真对比后,却得出了一个让甲方编辑们有些尴尬的结论:他和AI的文风相似,是因为他们学习的“教材”同源。

Marcus在文章中写道,他在肯尼亚接受的教育,将写作视为构筑“完美大厦”。他们被要求使用“首先、其次、最后”来搭建逻辑骨架,用“此外、然而、因此”来精确转折,词汇必须丰富华丽。这种极度追求规范、清晰与说服力的写作范式,是他们学术与职业生涯的“敲门砖”。

讽刺的是,大语言模型正是从海量的书籍、论文与正式文本中学习写作的,这些语料库本身就充满了这种经典的、正式的书面语风格。因此,当模型试图输出“权威、可信”的文本时,其文风便与Marcus所受的教育产生了惊人的“孪生效应”。他略带调侃地总结道:“这台机器为了显得权威,最终听起来却像个英语作文得了‘A’的肯尼亚小学毕业生。”

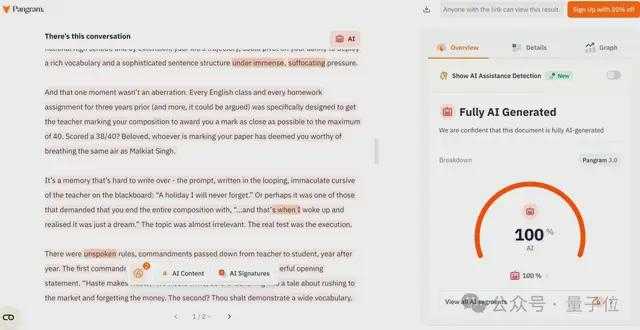

这篇旨在为自身“正名”、充满生活化比喻与人情味的文章,在Pangram网站的AI检测工具前,依然被判为“100%由AI生成”。

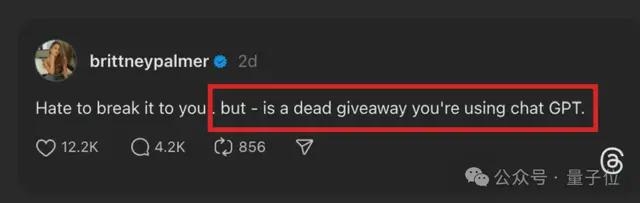

这一现象并非个案。它指向了一个更深层的问题:当前一些AI检测工具,可能将“流畅、严密、规整”的文本特点简单粗暴地归因于机器,而这恰恰是许多接受过严格正式写作训练者的行文特质,尤其是在非英语母语地区。这意味着,当AI模仿历史主流的正式文本时,它的“指纹”反而映照出了特定教育体系的“化石记录”。

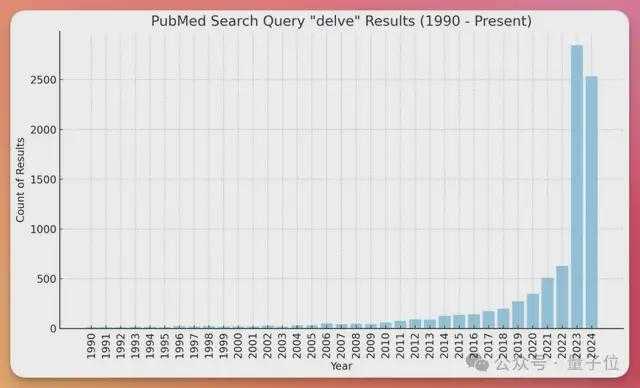

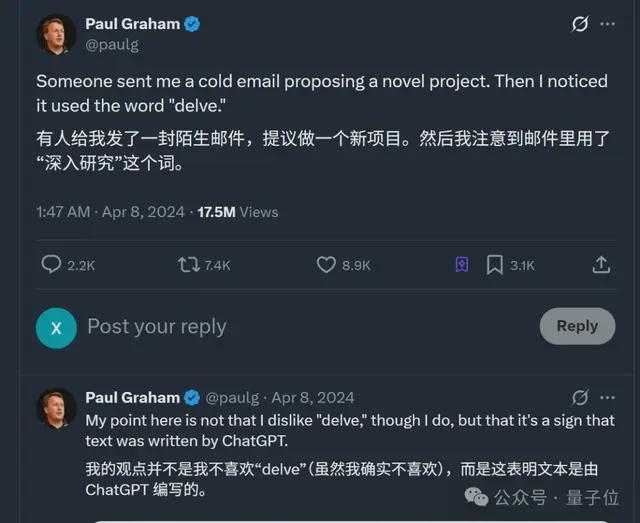

这一发现意外地为另一个有趣的AI语言现象提供了注脚:ChatGPT对“delve”(深入探究)等词汇的偏爱。去年,《卫报》便关注到,这个词在学术文献中的出现频率近年激增,背后被认为有AI辅助写作的影子。马斯克和YC联合创始人保罗·格雷厄姆都曾调侃,邮件中出现的“delve”一词简直是AI代笔的“告密者”。

其根源与这位肯尼亚作家的遭遇如出一辙:为了降低人力成本,训练和优化大模型(如RLHF)的大量工作被外包至非洲英语区。这些地区的专业工作者在提供反馈和撰写样本时,所使用的正是他们习以为常的、正式的商务学术英语词汇,如“delve”、“explore”、“leverage”。AI从这些海量的人类偏好数据中学习,最终将这些用词倾向固化在了模型之中。这并非“错误”,而是AI学习人类语言时自然吸收的“地方口音”。

这个故事远不止一个简单的趣闻。它揭示了全球人工智能发展中的一个复杂侧面:技术的“标准”输出,往往无意识地模仿并放大了历史上某类特定的、由经济和教育体系塑造的语言风格,并在反向影响现实世界的写作与评判。当曾经的“规范”变得可疑,谁在为“人性化”风格定义?

作家Marcus Olang’的经历,与其说是一次误判,不如说是全球化数字浪潮下,文化、教育模式与新兴技术标准之间一次微妙的碰撞。在AI日益普及的今天,如何理解、识别甚至重新定义“人类风格”,或许比单纯地“揪出AI”更为重要。