今日,苹果公司旗下音乐识别服务 Shazam 正式宣布推出名为“流行段落”(Popular Segments)的全新功能,旨在揭示一首歌曲中最受听众欢迎的具体片段。这一功能将通过分析海量识别数据,以视觉化图表的形式,将歌曲中被识别请求最集中的“高光时刻”呈现给用户与创作者。

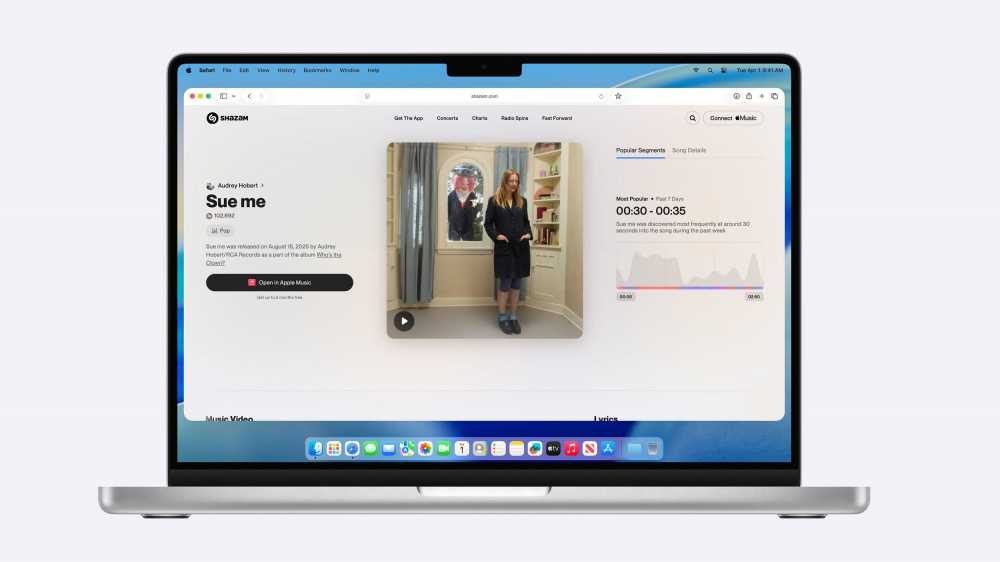

如上图所示,该功能会在一周的时间维度内,统计用户通过 Shazam 识别某首歌的具体时间点。例如,图表可能显示,一首歌在播放到第30至35秒时,触发了最多的识别请求,这通常意味着前奏结束、副歌开始或某个标志性乐器solo的段落最能抓住听众的耳朵。

“流行段落”功能旨在凸显过去一周内,驱动 Shazam 识别活动最集中的关键音乐时刻。该交互式功能将提供给位列 Shazam 排行榜前列的热门曲目,其数据基础是 Shazam 的标签识别量。它能展示歌曲中各个片段的相对流行度,用户只需将光标悬停在图表上,即可揭示精确的时间标记和对应的音乐段落。

Shazam 方面表示,“流行段落”将为听众和艺术家提供有价值的洞察,帮助理解歌曲的哪些部分最能引发共鸣。对听众而言,这可以快速定位到一首歌最精华、最“抓耳”的部分;对音乐人而言,这则是一种直观的数据反馈,有助于他们理解听众的偏好,甚至在未来的创作或现场表演编排中进行参考。

根据苹果公司的消息,这一功能将从今天开始,在 Shazam.com 网站的桌面端和移动端平台逐步上线。不过,官方公告中并未明确说明该功能是否会同步登陆 iPhone 和 iPad 上的 Shazam 应用。

Shazam 是一款广受欢迎的音乐识别服务,苹果公司于2018年将其收购,并已深度整合至 Apple Music 生态中。除了独立的网站和应用,Shazam 的功能也以“音乐识别”控件的形态内置于 iPhone、iPad 和 Mac 的“控制中心”内。用户同样可以通过 Siri 语音指令唤醒 Shazam 进行识别。

功能迭代的背后,是苹果对其服务生态数据能力的又一次挖掘与应用。将非结构化的音乐识别行为数据,转化为结构化的“流行度”图谱,这不仅增强了 Shazam 工具本身的趣味性与实用性,也可能为 Apple Music 的平台推荐算法及艺术家服务(如 Apple Music for Artists)提供新的数据维度。

此前,Shazam 的 iPhone 应用在上个月刚刚获得了采用“液态玻璃”(Liquid Glass)设计语言的界面更新。如今“流行段落”功能的推出,标志着 Shazam 正从一款单纯的识别工具,向一个集发现、洞察于一体的音乐数据分析平台演进。在全球流媒体音乐市场竞争愈发激烈的背景下,此类基于独特数据集的深度功能,有助于巩固 Shazam(及背后的苹果音乐生态)在用户心智中的技术领先地位。

目前,该功能仅支持网页端,其应用端的落地时间尚不明确。分析认为,这可能是苹果采取的常规灰度发布策略,旨在先通过网页渠道收集用户反馈并优化体验,待成熟后再集成至原生应用中。对于音乐爱好者和行业观察者而言,“流行段落”无疑提供了一个全新的视角来观察大众的音乐品味,其后续的数据呈现与演变值得持续关注。