AiSiri网8月7日消息,今天,阿里通义千问宣布发布更小尺寸新模型——Qwen3-4B-Instruct-2507和Qwen3-4B-Thinking-2507。

目前新模型已在魔搭社区、HuggingFace正式开源。

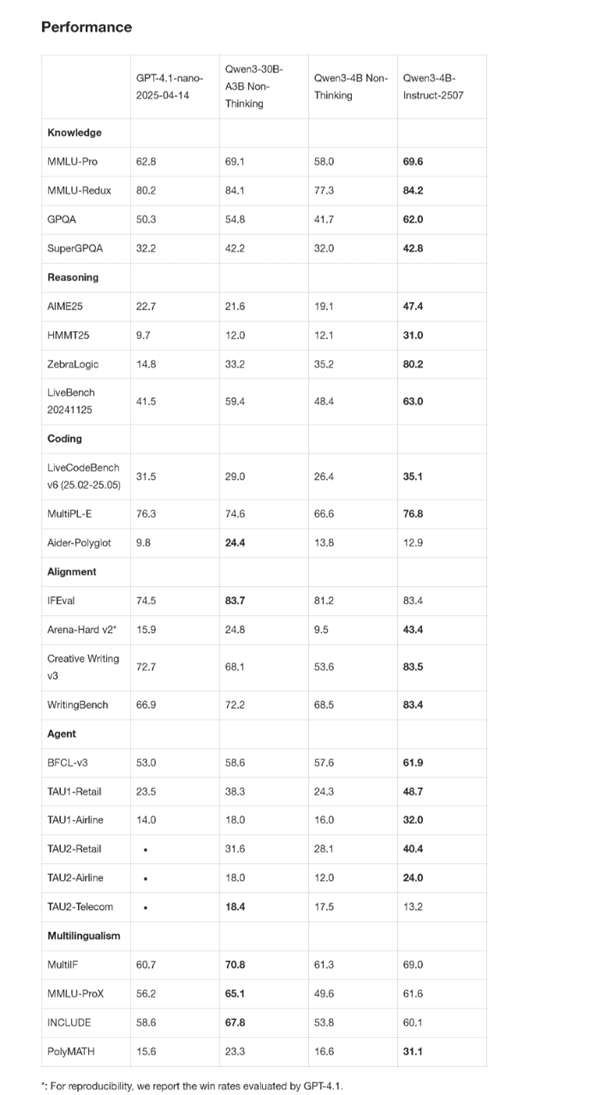

据说,在非推理领域,Qwen3-4B-Instruct-2507的某些方面已经超过了闭源的GPT4.1-Nano。

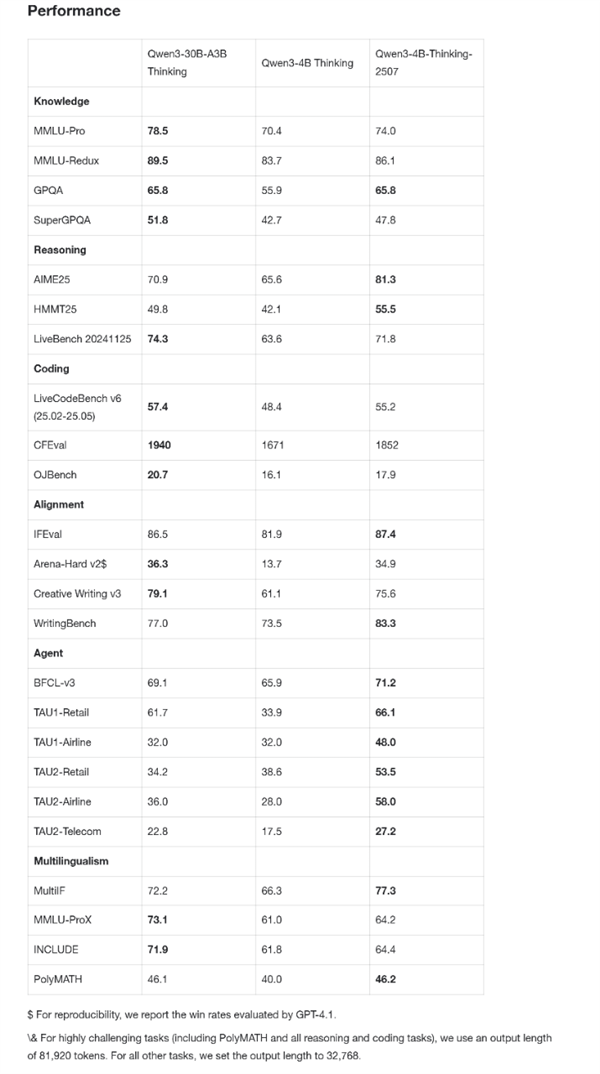

更令人关注的是,在推理能力上,Qwen3-4B-Thinking-2507甚至号称可以媲美中等规模的Qwen3-30B-A3B(thinking)。要知道,参数量直接影响模型大小和所需算力,小模型能达到这种水平,确实值得关注。

官方表示,2507版本的Qwen3-4B模型对手机等端侧硬件部署尤为友好。也就是说,以后在手机上跑一些AIGC应用,或许不用再担心卡顿了。这事儿要是真成了,想象空间还是很大的。

以下为模型核心亮点

Qwen3-4B-Instruct-2507

通用能力均大幅提升,与中等规模的Qwen3-30B-A3B(non-thinking)性能接近。这意味着,更少的资源消耗,也能获得不错的体验。

新模型覆盖更多语言的长尾知识,并且优化了人类偏好对齐,力图提供更贴合用户需求的答案。

号称上下文理解扩展至256K,这意味着小模型也能尝试处理一些长文本了。不过实际效果如何,还得后续观察。

Qwen3-4B-Thinking-2507

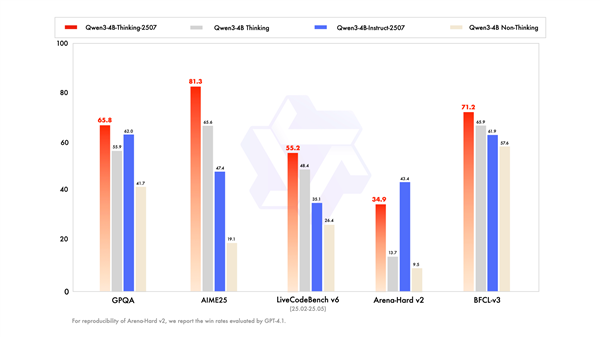

推理能力大幅增强,AIME25高达81.3分,官方宣称Qwen3-4B-Thinking-2507的推理表现可以与中等模型Qwen3-30B-Thinking相提并论。

特别是在数学能力测试AIME25中,以4B参数量获得81.3分。推理能力是否真的有提升,这倒是值得关注的一点。

Agent分数也不错,相关评测数据显示已经超越更大尺寸的Qwen3-30B-Thinking模型。

高达256K tokens的上下文理解能力,支持更复杂的文档分析、长篇内容生成、跨段落推理等应用场景。