AiSiri网8月4日消息,今日,腾讯混元发布四款开源小尺寸模型:0.5B、1.8B、4B、7B。

这四款模型消费级显卡即可运行,适用于笔记本电脑、手机、智能座舱、智能家居等低功耗场景,支持垂直领域低成本微调。

目前已在Github和Huggingface等开源社区上线,Arm、高通、Intel、联发科技等多个消费级终端芯片平台宣布支持部署。

这四款均属于融合推理模型,推理速度快、性价比高,用户可按需选择快思考或慢思考模式。

用户可根据使用场景灵活选择模型思考模式——快思考模式提供简洁、高效的输出;而慢思考涉及解决复杂问题,具备更全面的推理步骤。

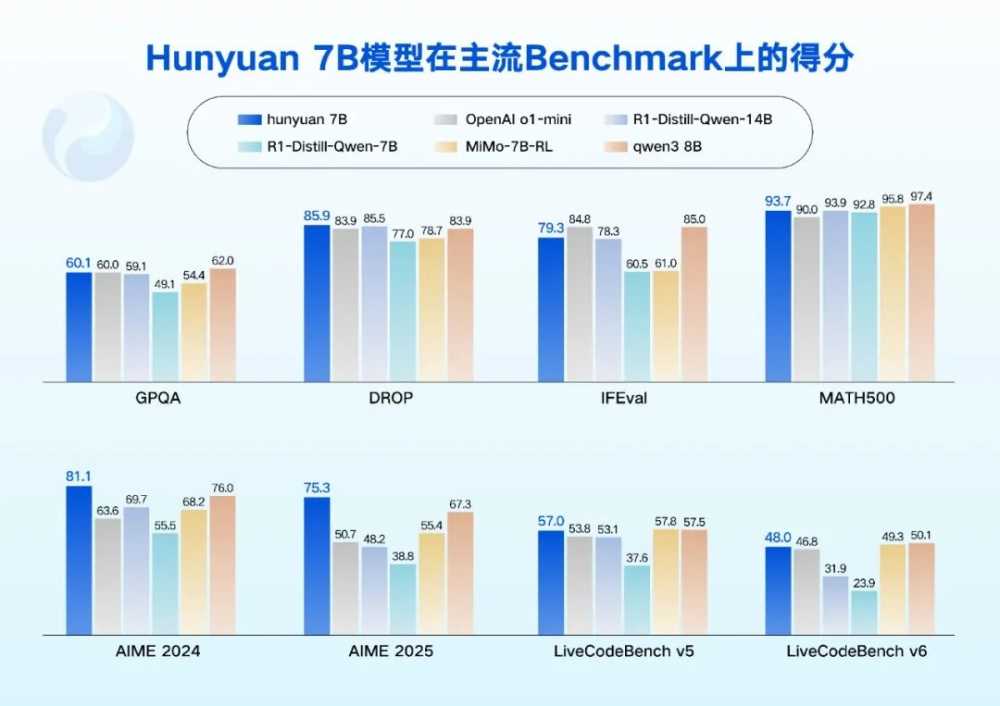

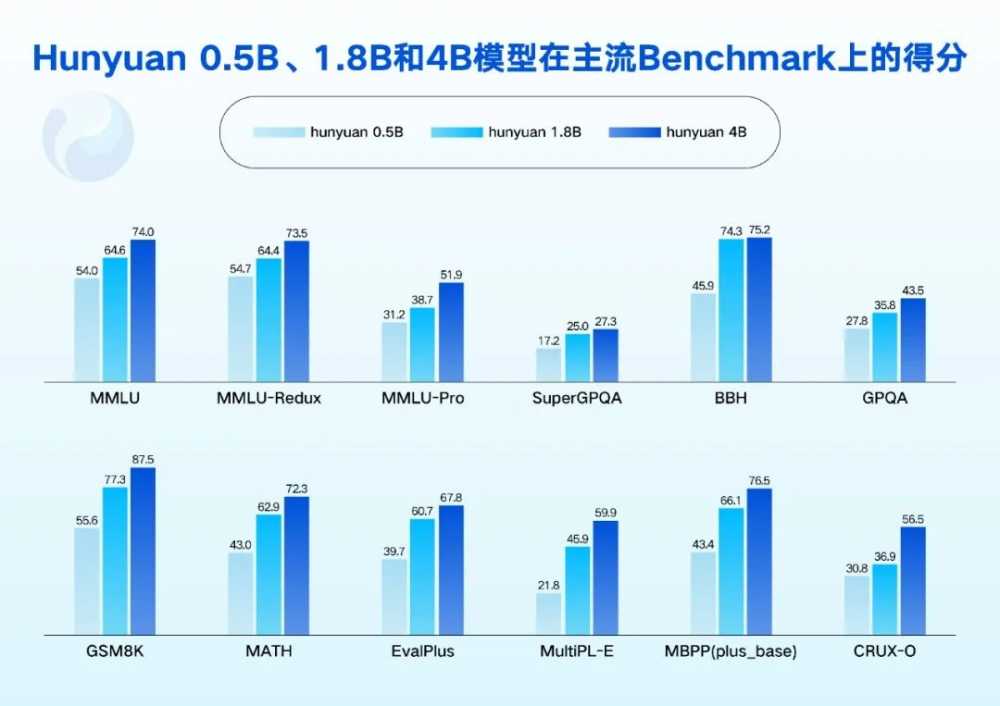

在语言理解、数学、推理等领域表现出色,在多个公开测试集上领先同尺寸模型。

只需单卡即可部署,部分PC、手机、平板等可直接接入,对主流推理框架和多种量化格式兼容性强。

具备突出的agent和长文能力,原生长上下文窗口达256k,意味着模型可以一次性记住并处理相当于40万中文汉字或50万英文单词的超长内容,相当于一口气读完3本《哈利波特》小说,并且能记住所有人物关系、剧情细节,还能根据这些内容讨论后续故事发展。

应用层面,四款小尺寸模型都能够满足从端侧到云端、从通用到专业的多样化需求,并且已经在腾讯多个业务中应用,可用性和实用性经过了实践的检验,是真正实用的模型。

例如,依托模型原生的超长上下文能力,腾讯会议AI小助手、微信读书AI问书AI助手均实现对完整会议内容、整本书籍的一次性理解和处理。

在端侧应用上,腾讯手机管家利用小尺寸模型提升垃圾短信识别准确率,实现毫秒级拦截,隐私零上传;腾讯智能座舱助手通过双模型协作架构解决车载环境痛点,充分发挥模型低功耗、高效推理的特性。

免责声明:本网站内容主要来自原创、合作伙伴供稿和第三方自媒体作者投稿,凡在本网站出现的信息,均仅供参考。本网站将尽力确保所提供信息的准确性及可靠性,但不保证有关资料的准确性及可靠性,读者在使用前请进一步核实,并对任何自主决定的行为负责。本网站对有关资料所引致的错误、不确或遗漏,概不负任何法律责任。任何单位或个人认为本网站中的网页或链接内容可能涉嫌侵犯其知识产权或存在不实内容时,可联系本站进行二次审核删除:fireflyrqh@163.com。