近期,关于知名大模型公司 DeepSeek 的一段讨论在网络上引发了不小的波澜,甚至出现了“DeepSeek 使用率从 50% 暴跌到 3%”、“DeepSeek 正在跌落神坛”等耸人听闻的说法。

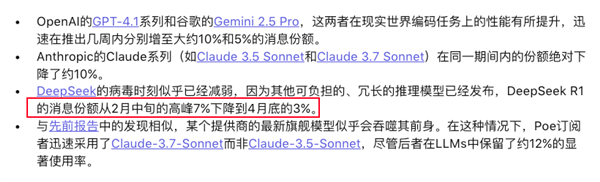

然而,经过深入分析,这些说法很可能是在信息传播过程中出现了误读和偏差。首先,DeepSeek 的使用率或许从未达到过所谓的 50% 的高峰。根据 AI 模型平台 Poe 的数据显示,即使在年初的顶峰时期,DeepSeek 的使用率也仅在 6%-7% 左右。

虽然近期 DeepSeek 的用户活跃度确实有所下降,相较于春节期间的使用量约减少了一半,目前其 R1 和 V3 模型在 Poe 平台的总使用率约在 3% 左右,但将此解读为“凉了”则有失偏颇。

这种误解的产生,很可能源于对“使用率下跌了 50%”与“使用率从 50% 开始下跌”概念的混淆,导致了信息在传播中发生了“质变”。

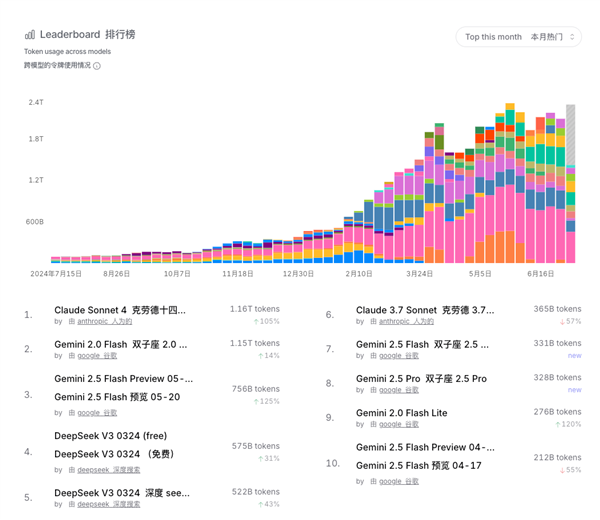

更深层次来看,评价大模型的发展,不应仅以单一平台的表面使用率作为唯一标准。首先,“大模型使用率”是一个复杂且难以精确统计的指标,不同平台和统计维度都会得出差异化的结果。例如,在 OpenRouter 等其他平台上,DeepSeek 的用户和使用量可能远高于 Poe 平台所展示的数据。

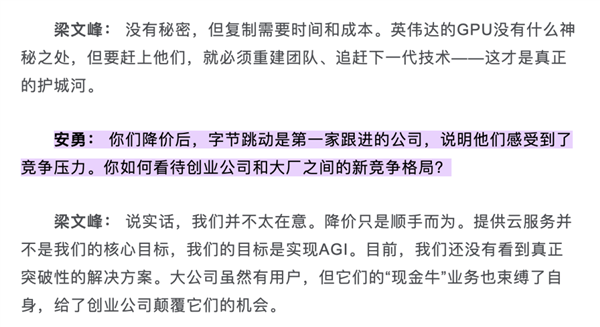

其次,DeepSeek 用户量的变化,可能与公司自身的发展战略有关。DeepSeek 并非以直接销售大模型服务为主要盈利模式,而是选择将自家模型进行开源,并积极与各行业伙伴合作,将底层能力“内嵌”到消费电子、智能助手等各类产品中。例如,腾讯元宝、百度搜索以及众多智能设备都已集成了 DeepSeek 的技术。

这种“渠道下沉”的策略,自然会分流一部分直接使用官方平台的用户。数据显示,虽然页面端流量有所波动,但通过第三方托管的 DeepSeek 模型使用量却在半年内增长了约 20 倍,这表明用户并非放弃了 DeepSeek,而是选择了更多样的使用途径。

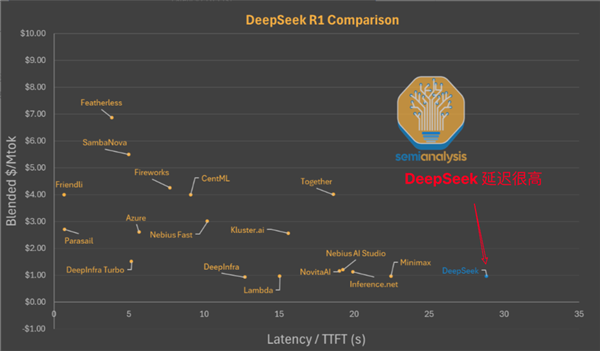

有趣的是,即使在官方 API 服务上,DeepSeek 也并非追求极致的用户体验。其 API 价格低廉的背后,是较高的系统延迟和相对较短的上下文长度(约 64K),这可能意味着 DeepSeek 更希望将有限的计算资源投入到核心技术的研发中,而非支撑海量的直接调用。

根据公司创始人梁文峰的表述,DeepSeek 的核心目标是实现人工智能(AGI),而非仅仅提供云服务。在显卡资源日益紧张的环境下,将有限的计算能力用于加速下一代模型(如 R2)的研发,以期更接近 AGI 的目标,是一种更为长远的战略考量。

因此,所谓的“DeepSeek 要凉”并非用户用脚投票的结果,更像是 DeepSeek 主动选择以一种更聚焦研发的方式,而非追求表面流量的方式来发展。对于业界而言,关注 DeepSeek 在模型技术迭代上的突破,或许比纠结于一时的使用率更能揭示其真实价值。