苹果的工程师团队最近搞出来一个所谓“AI代理”,号称能“精准描绘”街景场景。听起来像是为视障人士量身打造的“黑科技”,能让他们提前“虚拟探索”一个地方。先不说这东西能不能真正落地,就这动不动就拿“AI”、“LLM”这些词儿来包装,我先打个问号。

现在市面上针对盲人和视障人士的工具少吗?设备导航、环境引导,应有尽有。但苹果突然跳出来说,现有的不足,还得让人提前了解一个地方的“物理特征”?这话说的,好像之前大家都没想过似的。这逻辑,就像我之前在发布会上吐槽某手机厂商,明明是常规升级,非得吹成“颠覆式创新”。

他们通过所谓的“Apple机器学习研究”部门,发布了一篇论文,大谈特谈这个叫“SceneScout”的东西。听名字挺唬人,其实就是个“多模态大型语言模型驱动的AI代理”。说白了,就是个能看街景图,然后分析图片内容,再把结果描述给用户的AI。这不就是AI图像识别+文本生成嘛,真有那么神?

论文作者还特别提到了,视障人士通常不愿意在不熟悉的环境中独立出行,因为他们无法提前预知物理环境。这难道不是常识吗?用AI来解决常识问题,听起来像是为了创新而创新。微软早在2018年就推出了Soundscape这样的本地环境描述应用,但这都是“现场使用”的。苹果想搞个“预先体验”,听起来是进步了,但实际效果如何,还真不好说。

目前的出行建议,无非就是地标和逐向导航,对视障用户来说,缺乏“景观语境”。而那些街景图像,比如苹果地图的“环视”(Look Around),对健全人来说信息量巨大,但视障人士却无法感知。所以,这个SceneScout,就是要弥补这个空白。理论上听起来不错,但真正用起来会不会变成“信息噪音”?

SceneScout:听起来科幻,用起来悬浮?

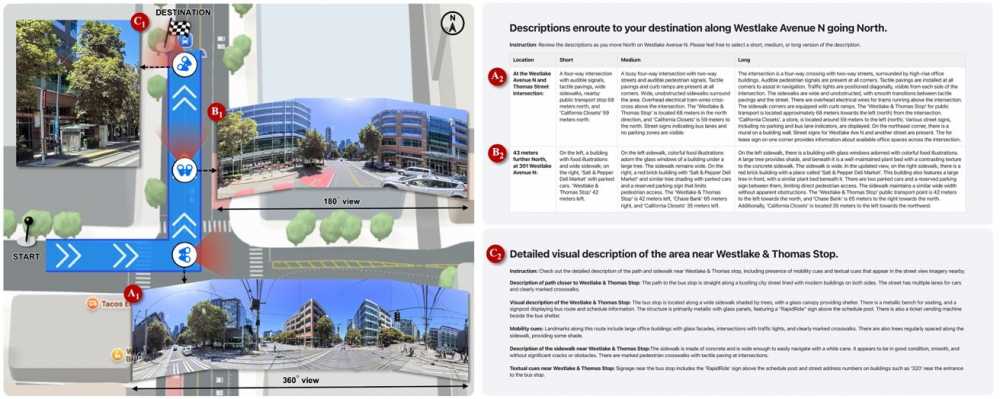

这个SceneScout,被吹嘘成一个能利用街景图像提供无障碍交互的AI代理。它有两种模式:一种叫“路线预览”(Route Preview),能提供路线上的各种元素细节。比如,能告诉你拐角处有树,或者其他一些能通过触觉感知到的元素。听起来很贴心,但“触觉元素”怎么通过图像来描述?难道要AI告诉你,这个树皮是粗糙的,那个路标是光滑的?这有点超出AI的能力范畴了吧。

SceneScout的输出示例,看起来有些复杂

另一种模式叫“虚拟探索”(Virtual Exploration),就是让你能在街景图像里“自由移动”,AI会随着你的“移动”来描述周围的元素。这听起来有点像玩游戏,不过是为了帮助视障人士。但问题是,这种“虚拟移动”真的能模拟线下的真实体验吗?线下的环境是动态变化的,而街景图像是静态捕捉的,两者之间存在天然的鸿沟。

在他们的用户研究中,团队声称SceneScout对视障人士“非常有帮助”,因为能挖掘出他们通过现有方法无法获取的信息。但紧接着,他们话锋一转,说大多数描述是准确的,有72%的准确率。但同时也承认,偶尔会有“微妙且合理的错误”,这使得不通过视觉验证,描述很难被证实。这就很有意思了,一款为视障人士设计的产品,却需要视觉才能验证其准确性?这不就是脱裤子放屁吗?而且,72%的准确率,这在实际应用中,真的能满足需求吗?万一那28%的错误导致用户发生意外,这责任谁来承担?

参与者提出了改进意见,比如SceneScout应该提供个性化的描述,并能适应不同会话。比如,系统能根据用户的偏好来侧重描述某些信息。这听起来是优化方向,但实现起来可不简单。另一个建议是,把描述的视角从“车顶摄像头”转换成“行人视角”。这倒是比较实在的建议,毕竟用户是用脚走路,不是用摄像头飞行。如果能做到,那确实能提升实用性。

还有人提出,希望街景描述能实时提供,能和他们实际行走的位置匹配。这就更异想天开了。这要用到骨传导耳机或透明模式,还需要陀螺仪和指南针来进行方向校准,这些技术实现起来都还有很多挑战。而且,实时性对数据传输和处理的速度要求极高,目前的技术能否支撑,还要打个问号。这些建议听起来都很美好,但最终能实现多少,又有多大的实用价值,都还是未知数。

未来的应用:画饼还是真香?

就像专利申请一样,一篇详细描述AI新用途的论文,并不能保证它会在未来的产品或服务中实现。但它至少能让我们一窥苹果对这项技术的考量。这不就是科技公司在发布新专利、新论文时一贯的套路吗?先放个概念,看看市场反应,再决定是不是真的投入。这种“试探性”的发布,往往意味着产品离真正落地还很远。

虽然没直接使用街景图像,但这种方法可能会利用一些传闻中的苹果产品。比如,那些传闻中内置摄像头的AirPods,还有带摄像头的Apple Glass智能眼镜。在这些设备上,摄像头能让“Apple Intelligence”看到世界,然后根据用户的查询提供信息。听起来很科幻,但想想目前的智能眼镜和AR眼镜的普及程度,以及它们在现实生活中的实用性,这种设想的前景,我表示谨慎乐观。

想象一下,一个能实时描述周围环境的系统,听起来是挺诱人的。但关键在于,它使用的是“实时数据”,而不是那种“可能过时”的街景图像。这就对数据采集、传输、处理的实时性和准确性提出了更高的要求。这种美好的愿景,什么时候能真正成为现实,还请大家拭目以待。反正我是觉得,这波“AI赋能”,噱头大于实际,距离真正能解决用户痛点,还有很长的路要走。