一份研究报告表明,结合人类指导员和机器人示范者,可以更有效地训练人形机器人。这种新的组合方法被称为 “PH2D”。

在发布 Matrix3D 和 StreamBridge AI 模型一周后,苹果公开了关于机器人以及如何训练它们的新研究。 苹果之前的机器人项目包括创造一个机器人灯,但最新的研究专门针对人形机器人。

这份题为 “Humanoid Policy ~ Human Policy” 的研究论文,详细描述了传统机器人训练方法的不足之处,并提出了一种兼具可扩展性和成本效益的新解决方案。

苹果的研究表明,与其仅仅依靠机器人示范者进行人形机器人训练(论文称这一过程“劳动密集型”,并且需要“昂贵的遥操作数据收集”),不如采用一种结合人类指导员和机器人示范者的综合方法。

这旨在降低与培训相关的成本,苹果的研究解释说,该公司能够通过使用改装的消费类产品来生成人形机器人的培训材料。

具体来说,一台 Apple Vision Pro 经过改装,只使用左下角的摄像头进行视觉观察,而 Apple 的 ARKit 被用来访问 3D 头部和手部姿势。该公司还使用了一种改装的 Meta Quest 头显,配备了迷你 ZED 立体摄像头,这有效地使其成为一种低成本的培训选择。事实证明,利用消费级设备进行训练可以显著降低研发成本。

改装后的头显被用于训练人形机器人的手部操作。人类指导员被告知要坐直,并用他们的手执行动作。这包括抓取和举起特定物体以及倾倒液体等,并且在录制动作时提供了声音指导。然后将生成的镜头放慢速度,以便用于人形机器人训练。这种方式极大地简化了数据收集流程,降低了对专业设备和复杂环境的依赖。

人类指导员使用改装后的 Apple Vision Pro 头显作为培训过程的一部分。 图片来源:苹果

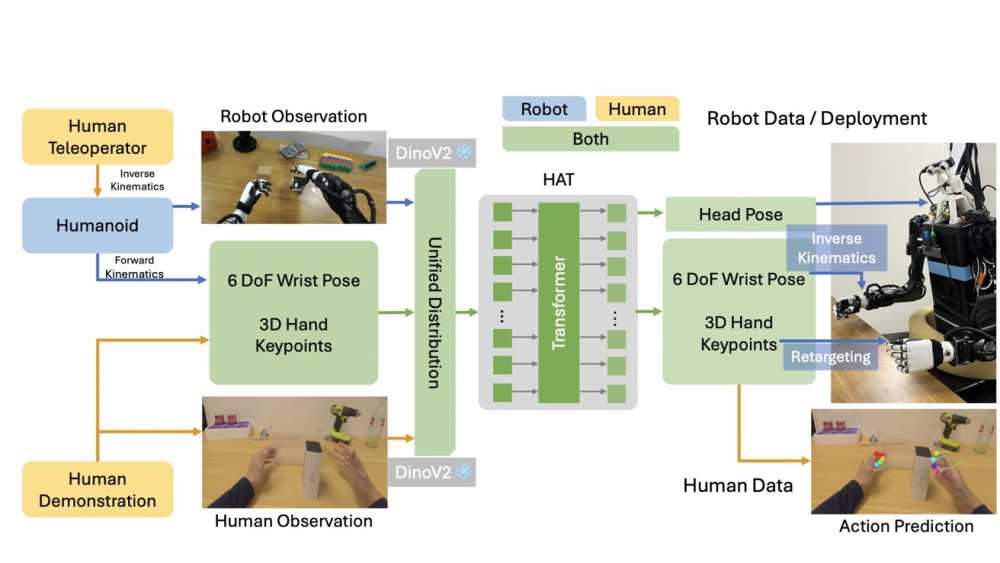

苹果创建了一个模型,可以处理人类指导员和机器人示范者创建的培训材料——该论文称之为 “Physical Human-Humanoid Data” 或 PH2D。 处理数据的模型,被称为“Human-humanoid Action Transformer”或 HAT,能够处理由人类和机器人创建的输入。

研究人员能够将人类和机器人演示来源统一到一个“通用策略框架”中。研究论文称,这种独特的方法带来了“与仅使用真实机器人数据训练的对应方法相比,改进的泛化和鲁棒性”。这种混合训练方式利用了人类的认知能力和机器人的精确执行能力,提升了机器人的适应性和学习效率。

苹果的 HAT 可以处理机器人示范者和人类指导员创建的数据。图片来源:苹果

苹果的研究表明,使用这种组合训练策略具有显著的优势。除了具有成本效益之外,与那些仅使用机器人示范者训练的机器人相比,使用这种方法训练的机器人产生了更好的结果。但是,这仅适用于某些任务,例如垂直物体抓取。值得注意的是,该方法并非适用于所有场景,仍需针对特定任务进行优化。

苹果可能会在未来的产品中实施这种训练方法。 虽然到目前为止只展示了它的机器人灯原型,但据说苹果正在开发一种面向终端消费者的移动机器人,它可以执行家务和简单的任务。这也预示着苹果在智能家居和个人助理领域具有更大的发展潜力。