4月1日讯,苹果悄然放出惊喜,iOS 18.4更新带来Apple Intelligence对包括简体中文在内的八种语言支持,新加坡和印度用户迎来本地化英语版本。这比此前官方预告的2025年4月上线中文版的节奏,似乎快了一步。

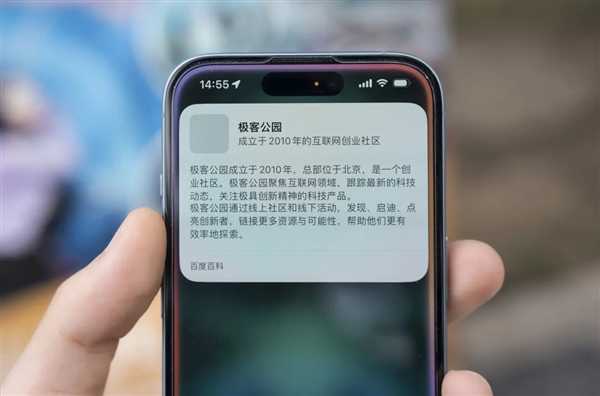

中文版 Apple 智能 UI 界面 | 图片来源:极客公园

虽说这次更新不等同于Apple Intelligence国行版,毕竟目前国内iPhone用户还暂时无法直接体验,但苹果正在加速本地化进程。细心的人会发现,搜索结果中已经开始出现百度搜索、图片搜索的中文内容适配,甚至悄悄用上了百度百科。这与之前传闻的苹果与百度合作的消息不谋而合。

对于已经能体验Apple Intelligence的海外用户来说,这次更新重头戏自然是中文支持。虽然Apple Intelligence主打端侧处理,但遇到需要网络搜索的海量请求时,还是得仰仗“百度百科”这类本地内容源,作为可靠补充。简单来说,中文版Apple Intelligence已经开始大量引用百度搜索/百度百科,作为信息补充。

在网络搜索内容上,中文版 Apple 智能会优先调用百度的内容作为本地来源 | 图片来源:极客公园

目前,Apple Intelligence的处理流程是:Siri接到用户提问,iPhone端侧模型搞不定时,会将数据上传到苹果私有云服务器。服务器端进一步处理后,如果仍然需要外部支援,比如ChatGPT,才会将脱敏后的请求数据转发给OpenAI服务器。最终,结果再原路返回给用户。

所以,用户最终用的还是ChatGPT-4o。即使有了中文版,之前的英文版体验中频繁出现的“抄送给ChatGPT”现象,依然存在。免费用户依然有ChatGPT额度限制,而订阅了ChatGPT Plus的用户,则可以在iPhone上无限次调用。

在涉及到复杂问题的请求上,「抄送给 ChatGPT」仍然没有改变 | 图片来源:极客公园

图像识别方面,iOS 18.2新增的“视觉智能”也加入了中文支持。简单的图像搜索/识别,比如问“这是什么猫猫”,它能依靠云端知识库给出中文回复。但有趣的是,当用ChatGPT的多模态内容识别能力时,即使用户已经将系统界面和Apple Intelligence都设置为中文,经由苹果私有云服务器转发的ChatGPT请求,仍然返回英文结果。看来,苹果的本地化,还有一段路要走。

部分时候经由 Apple 私有云服务器转发的 ChatGPT 返回的内容仍然会以英文展示 | 图片来源:极客公园

相比之下,基于Google搜索的图像内容搜索能力,在全中文环境下运行后,却能优先从中文内容中抓取结果。这对于需要即时中文互联网信息的搜索来说,无疑能提升信息流畅度和准确度。比如,用Apple Intelligence识别华为刚发布的Pura X手机,它就能准确识别出具体型号和官网信息。

Apple 智能准确识别到了华为刚发布的新机 Pura X 的信息 | 图片来源:极客公园

所以,在没有接入中国本土服务商的多模态大模型识别服务的前提下,Apple Intelligence在多模态内容识别的体验还有待提高。但好消息是,与百度/阿里的合作正在推进中,或许未来能带来更进一步的本地化体验。

Writing Tools写作工具也加入了中文支持,可以校对、改写或总结文本,还能通过ChatGPT直接起草内容。这对于很多人来说,可能是最熟悉的大模型应用场景之一了。无论是改写还是直接生成文档,在中文场景下都能给出类似ChatGPT水准的体验,加上与Apple输入法/第一方App的整合,实用性有所提升。

文本生成工具或许是很多人最熟悉的大模型应用领域 | 图片来源:极客公园

苹果在AI上的策略,似乎并不追求“最快”,而是“最稳”。这种“保守”或许源于苹果对新技术一贯的“谨慎”,不仅不急于拓展AI能力在智能手机上的边界,还在主动为AI设置围栏。在备忘录AI改写功能中,写作风格偏向保守;在用于创建风格化自定义图像的Playground中,也无法像其他图像生成模型那样,生成与真人几乎无异的图像。

Playground 生成 Genmoji 效果|图片来源:Apple

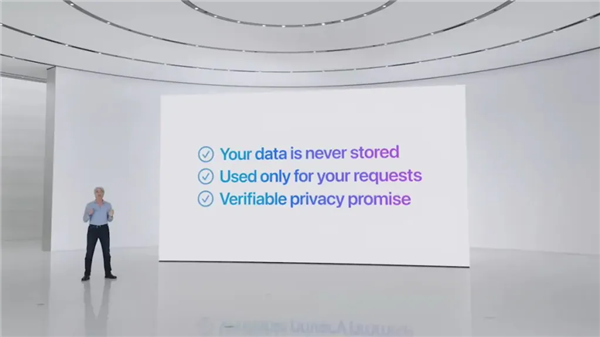

这种谨慎并非没有道理:即使多模态大模型已出现几年,但内容幻觉、AI生成内容被用于犯罪等问题,依然伴随着大模型应用。在AI时代,如何保护用户隐私数据成为了重要命题,而苹果是首先直面这一问题,并喊出解决方案的厂商。

Apple Intelligence的最大特征之一,就是在AI时代坚持“隐私优先”的技术路径。系统默认在设备本地完成处理;当任务超出本地处理能力时,会通过“私有云计算”调用苹果自研服务器,并全程加密,确保用户数据不会被用于模型训练或第三方存储。

苹果是目前唯一公开讲解如何用私有云转发机制来保护用户隐私的厂商 | 图片来源:极客公园

除了硬件,面向开发者的工具也已在路上:苹果更新了编写工具API、Genmoji API和Image Playground API。开发者可以将Apple Intelligence集成到他们的应用程序中,在所有Apple生态硬件设备上调用端侧模型计算能力,无需额外服务器成本。对于开发者来说,这无疑是极具诱惑力的。

苹果似乎并不谋求短暂的效果取胜,而是通过构建软硬件深度整合、原生AI硬件生态平台,为开发者提供适合AI时代超级App生长的土壤。长期来看,只有像苹果、华为这样,拥有自有生态/硬件以及掌控能力的厂商,才有机会参与深度竞争。拥有生态的平台级玩家,与只有“硬件制造商”标签的厂商,或许从一开始就拉开了巨大差距。

那么,回到最初的问题:“支持简体中文后的Apple Intelligence,真的更好用了吗?” 有变得更好用,但苹果的下一步,或许更值得关注。这才是Apple Intelligence在一步步迈向中国用户的过程中,最值得关注的问题所在。